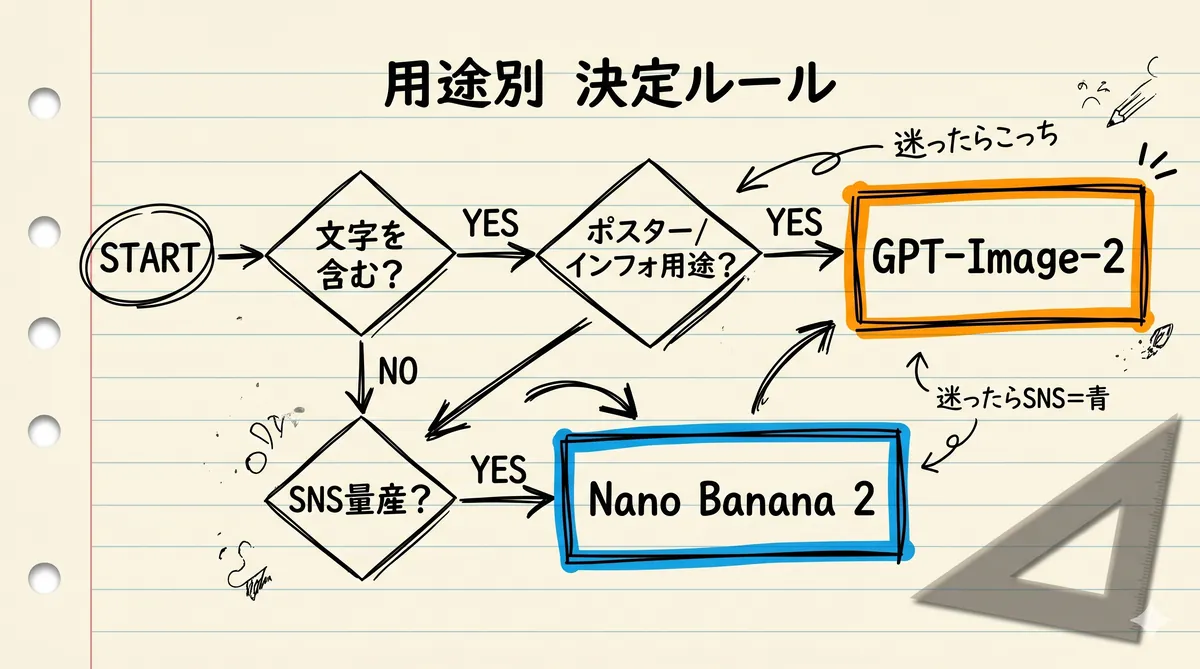

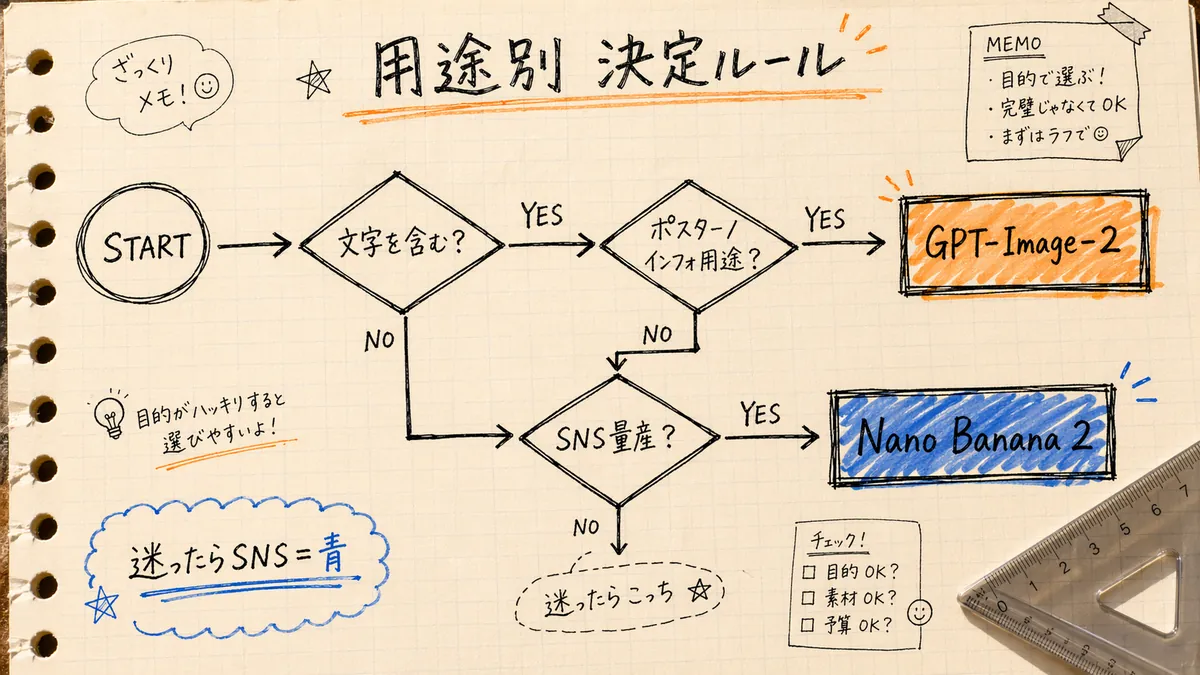

この記事の結論

Image Arena上の242点差は「絵全般の強さ」ではなく、文字描画と構造制御に偏った差です。

同じJSONを両モデルに投げた時、共通8キーはほぼ効く。

差分はNano Banana 2のtext_contentとGPT-Image-2のconstraintsで割れます。

SNS量産とA/Bテストは速度と価格でNano Banana 2、ポスター・インフォグラフィックの文字含み案件はGPT-Image-2。

この線引きが用途決定の軸です。

この記事は画像生成モデルを業務で使い分けたい人向け(AIで画像を作った経験があれば読めます)。

Nano Banana 2とGPT-Image-2。

2026年2月と4月に連続で出た2モデルを、同じJSONプロンプトで動かした時に何が保たれて何が壊れるか。

Image Arenaの公開データによれば、GPT-Image-2のEloは1,507〜1,512、Nano Banana 2は1,271で、差は約236〜242点(出典: arena.ai/Bind AI)。

複数メディアが「Arena史上最大の#1-#2格差」と伝えています。

ただ、数字の中身を開けないと使い分けは決まらない。ここが今回の本題。

Nano Banana 2とGPT-Image-2は何が違うモデルなのか

前提の整理から始めます。

Nano Banana 2はGoogle DeepMindの画像モデルで、正式IDはgemini-3.1-flash-image-preview。

2026年2月26日に発表されました(出典: Google公式blog)。

公式ページの説明は「State-of-the-art, Pro-level image generation and editing. Flash-level speed」(出典: DeepMind)。

Flashの名の通り、速度を軸に設計された系統です。

GPT-Image-2はOpenAIのChatGPT Images 2.0。

モデルIDはgpt-image-2で、スナップショットはgpt-image-2-2026-04-21(出典: OpenAI公式)。

リリースは2026年4月21日、つまりNano Banana 2の約2ヶ月後。

特筆すべき技術差分は、GPT-Image-2が推論モード(Thinking)を統合していること。

生成前に計画とweb検索を挟んで描き始めます。

The Decoderはこの挙動を「reasoning and web search to image creation」と表現(出典: The Decoder)。

両者とも速度志向と推論志向で哲学が正反対。ここが比較のスタート地点です。

料金はどちらが安いのか(1画像あたり比較)

ここがまず混乱しやすい。

Nano Banana 2は画像単価で明示、GPT-Image-2はトークン課金です。

Nano Banana 2は解像度別の一律料金(出典: aifreeapi)。

GPT-Image-2の1画像単価はlaozhang.aiの換算値が最も細かい(出典: laozhang.ai)。

| 解像度・品質 | Nano Banana 2 | GPT-Image-2 |

|---|---|---|

| 1024×1024(Low/1K) | $0.067 | $0.006 |

| 1024×1024(Medium) | — | $0.053 |

| 1024×1024(High) | — | $0.211 |

| 2K(2048px) | $0.101 | Mediumで$0.053相当 |

| 4K(4096px) | $0.151 | 非対応(最大3840px) |

| バッチAPI | 全解像度50%引き | 全項目50%引き |

1K+Low品質で比べるとGPT-Image-2は$0.006。

Nano Banana 2の$0.067より10倍以上安い。

ただしHigh品質にすると$0.211でNano Banana 2の1K価格の3倍以上です。

つまり「GPT-Image-2が安い」は半分本当で半分嘘。

品質設定でひっくり返る。

量産するだけならGPT-Image-2 Low。

最終納品レベルまで詰めるならNano Banana 2の1K〜2Kが読みやすい価格帯です。

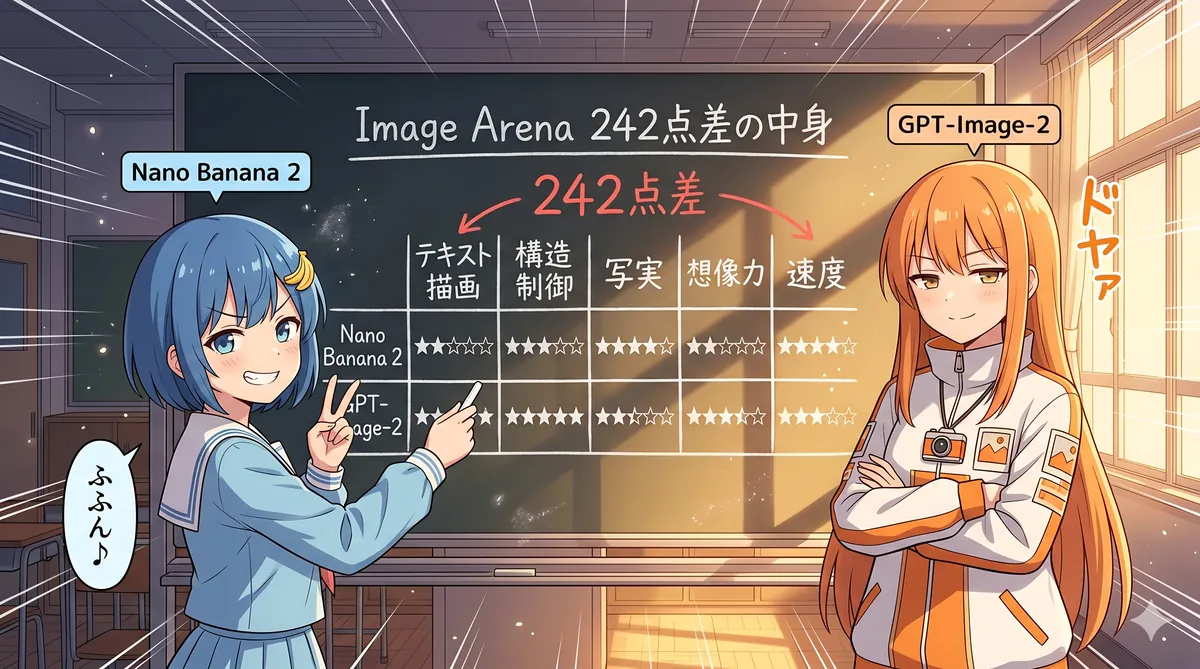

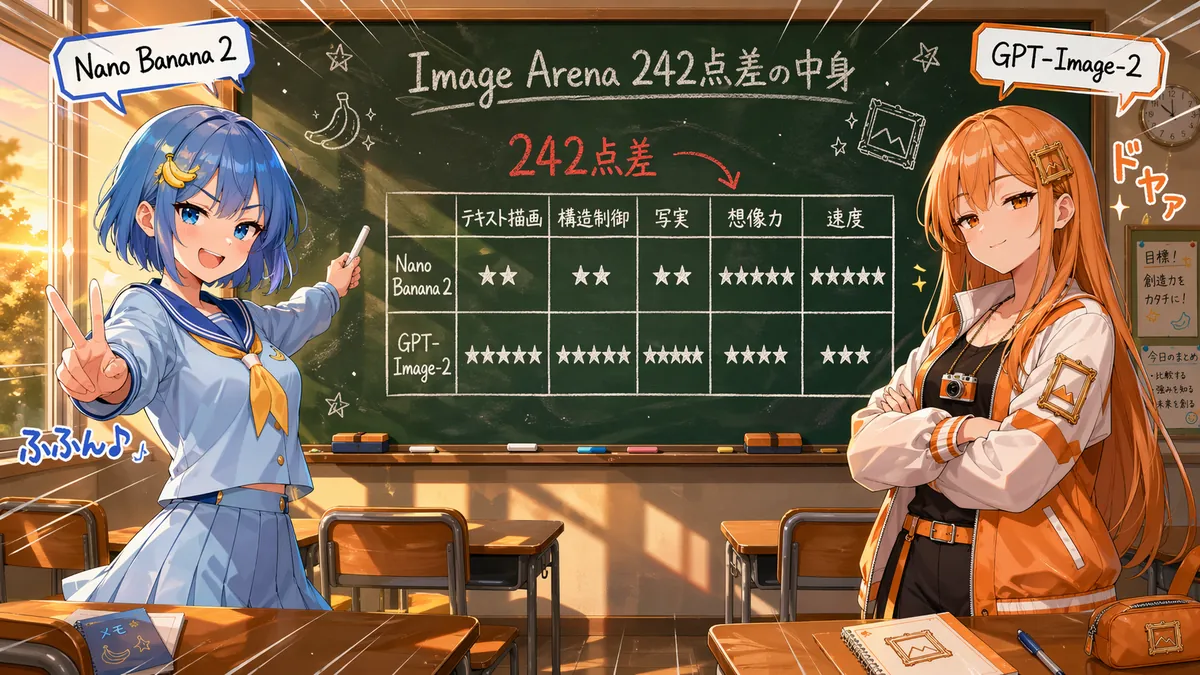

Image Arena 242点差は何の差なのか

数字を先に並べます。

arena.ai上の最新公開スコア(出典: arena.ai)。

- GPT-Image-2(Medium): Elo 1,507±9(#1、投票数15,391、Preliminary扱い)

- Nano Banana 2: Elo 1,271±5(#2、投票数55,988)

- 差分: 約236ポイント

Bind AI記事はleaked LM Arenaデータ由来で「1,512対1,360、差242点」と報じています(出典: Bind AI)。

Implicator.aiは「record 242 points」と書いています(出典: Implicator.ai)。

ここで気をつけたいのは、Arenaスコアは「絵全体の好み投票」ではなく、文字描画・構造精度・写実性などが複合された総合指標ということ。

ジャンル別のEloを見ると中身が割れます。

- 単一画像編集: GPT-Image-2が1,513(Nano Banana比+125点)

- マルチ画像編集: GPT-Image-2が1,464(Nano Banana比+90点)

編集タスクで差が開いている。

一方で、jxp.comはこう整理しています(出典: jxp.com)。

「GPT Image 2 wins on structural control and text rendering, while Nano Banana 2 wins on photorealism and generation speed」

242点差は「構造制御と文字」に偏った差。

写実性と速度ではNano Banana 2が勝つ、というのが現状の整理です。

私が注目しているのは、この数字を「絵全般の強さ」と読まずに「どの軸で差がついたか」で受け取る視点です。

文字描画精度「99%」は本当なのか

ここは要注意。

複数メディアが「約99%」「〜99%」と書いていますが、OpenAI公式発表での明示的な数字ではありません。

OpenAI公式ブログの表現は「near-perfect text rendering」のみ(出典: OpenAI公式)。

99%の数字はBind AIが「leaked LM Arena data and early tester reports」由来と明記しています。

VentureBeatはこう書きました(出典: VentureBeat)。

「multilingual text, full infographics, slides, maps, even manga — seemingly flawlessly」

OpenAI CEOは「gpt-image-1からgpt-image-2への跳躍はGPT-3からGPT-5相当」と発言しています(複数メディアで報道)。

派手な言葉が並びますが、一次情報ベースで言えるのは「near-perfect」までです。

Nano Banana 2は対照的で、短文・ラテン文字はほぼ正確。

文法・スペル・文化ニュアンスで一部課題が残る、とjxp.comが記録しています(出典: jxp.com)。

文字を含む案件はGPT-Image-2寄り。

これがArena差のコアの要因、というのが私の見方です。

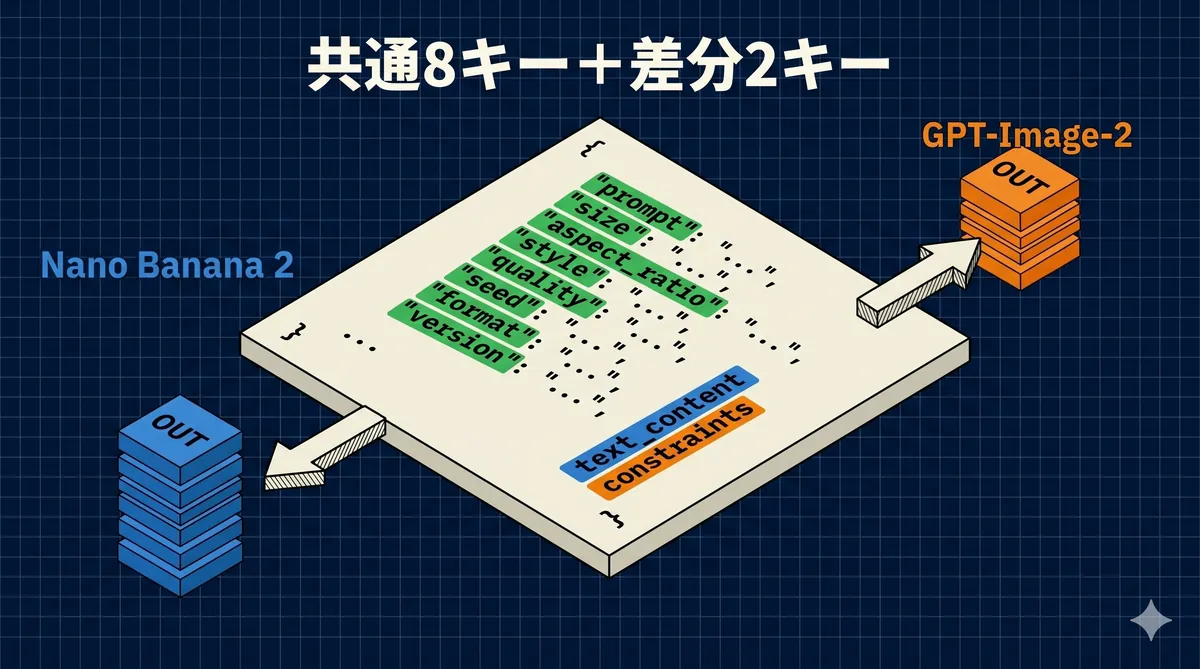

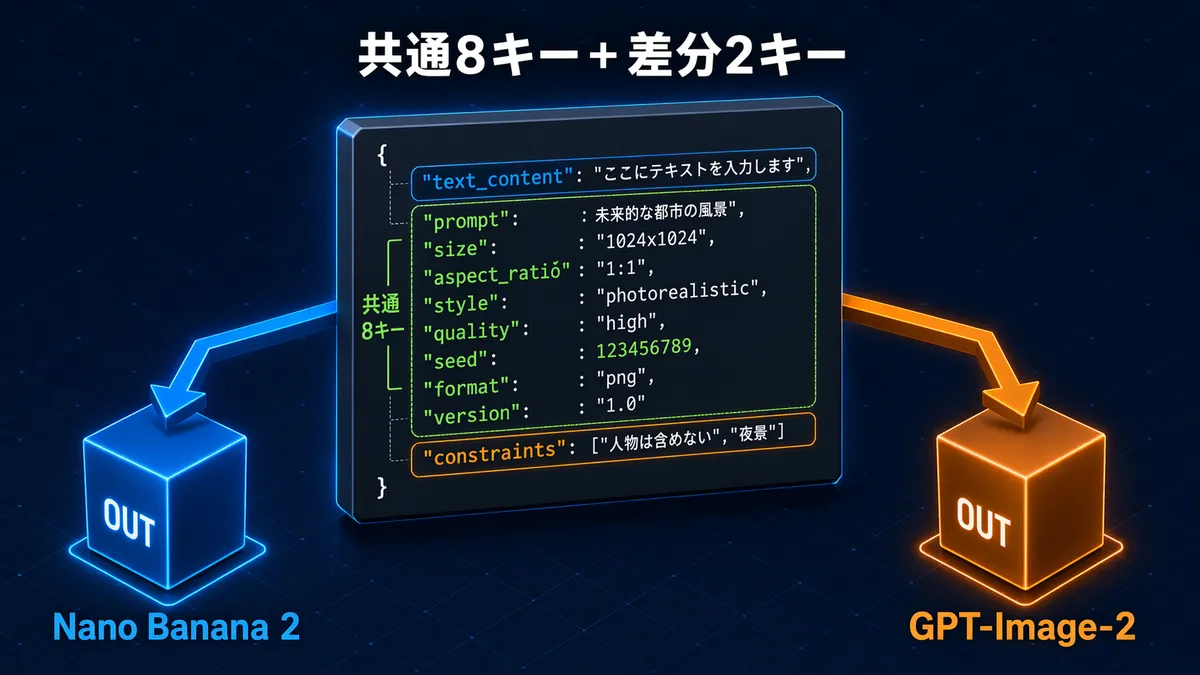

同じJSONを両モデルに投げると何が起きるのか

ここが本記事の本題。

日本語圏のJSONプロンプト記事はscombu.com、web-den.com等を見ても、ほぼすべてNano Banana単独の解説。

両モデルへの同一JSON投入比較は空白です。

ただ、両モデルのコミュニティドキュメントを突き合わせると、共通で機能するキーが見えてきます。

両モデル共通で動く8キー

Nano Banana 2側のscombu・web-den・atlabsガイドと、GPT-Image-2側のfal.ai公式ガイド(出典: fal.ai)・OpenAI Cookbook(出典: OpenAI Cookbook)を重ね合わせると、以下8キーが両者で共通して出現します。

| キー | Nano Banana 2での役割 | GPT-Image-2での役割 |

|---|---|---|

scene | 場所・背景(公式Framework 1) | Background/Scene(Cookbook順序1) |

subject | 主役オブジェクト | Subject(Cookbook順序2) |

style | 美的アンカー | Important detailsの一部として機能 |

lighting | 光源・方向・質 | Important detailsで明示推奨 |

camera | レンズ・絞り・ISO | Important detailsのカメラアングル・レンズ感 |

mood | 雰囲気・感情トーン | Important detailsのムード |

aspect_ratio | 公式APIパラメータ(14種対応) | APIパラメータ(9種対応) |

composition | 構図・フレーミング | Cookbookの構図指定 |

この8キーは両モデルに投げて安定。

ここを共通テンプレとして抱えておけば、モデルを切り替える度にプロンプトを書き直さずに済みます。

Nano Banana 2でだけ効くキー

Google Cloud公式プロンプトガイドの要点(出典: Google Cloud)。

text_content: 描きたい文字列。ダブルクォートで囲む必須(例:"URBAN EXPLORER")text_rendering: フォント指定(例: bold, white, sans-serif)meta.thinking_level:"minimal"(デフォルト)or"high"search_grounding: リアルタイムweb検索統合- 最大14枚の参照画像(キャラクター4枚+オブジェクト10枚)

特にtext_contentの引用符ルールは独自。

GPT-Image-2にそのまま投げても引用符を解釈する仕様は同じではありません。

GPT-Image-2でだけ効くキー

fal.ai公式ガイドとOpenAI Cookbookの推奨から抽出。

use_case: editorial photo / product mockup / poster / UI screen / infographic / concept frameconstraints: no watermark / no logos / no extra text / preserve face / preserve layoutchange/preserve: 編集モード専用キー

constraintsがとにかく効く。

Nano Banana 2に同じキーを入れても、fal.aiが想定する挙動ほど強くネガティブ指定が通らない、というのが両ドキュメントを見比べた時の読み取り。

あと忘れがちな一点。

OpenAIのAPIドキュメントはGPT-Image-2のStructured Outputsを「非対応」と明記しています(出典: OpenAI API Docs)。

JSONはあくまでプロンプト文字列内の構造として渡すことになります。

APIパラメータとしての構造化出力は使えない。

ここ勘違いしやすい。

両モデル共通テンプレを実装する手順

ここから読者が同じことを再現できる手順に落とします。

Google Cloud公式とfal.ai公式ガイドを突き合わせて、共通8キーを両方に投げるフローです。

- STEP1. 共通JSONテンプレをファイル化する。

common8.jsonとしてscene/subject/style/lighting/camera/mood/aspect_ratio/compositionの8キーを空欄で保存。値は案件ごとに埋める運用。期待結果: テキストエディタで開いて8項目が並んでいればOK。詰まりどころ: コメントは入れない(モデルが指示として読む)。 - STEP2. Nano Banana 2用に差分キーを足した

nb2-extend.jsonを作る。text_content(ダブルクォートで囲む)・text_rendering(フォント)・meta.thinking_levelを追加。Gemini APIのaspect_ratioは14種から選択(1:1 / 3:2 / 16:9 等)。期待結果: 共通8+3で計11項目。詰まりどころ:text_contentの引用符を外すと文字が崩れる。 - STEP3. GPT-Image-2用に差分キーを足した

gpt2-extend.jsonを作る。use_case・constraints・(編集時は)change/preserveを追加。aspect_ratioは9種から選ぶ。期待結果: 共通8+2〜4で計10〜12項目。詰まりどころ:constraintsに長文を入れると効きが弱まる。1行3〜5項目程度に絞る。 - STEP4. 同じ案件で両方のJSONを投げて比較する。Nano Banana 2はGemini APIの

generateContent、GPT-Image-2はv1/images/generationsエンドポイント。プロンプト文字列部分にJSONを埋め込む形。期待結果: 2モデル分の画像が返る。詰まりどころ: GPT-Image-2はThinkingモードがPlus以上限定、フリーティアは使えない。 - STEP5. 結果を3軸で採点する。①文字描画の正確さ ②人物の手足など構造の崩れ ③生成速度。3案件も回せば自社の用途に合う方が見えてきます。期待結果: 用途別に明確な「勝ち負け」が出る。詰まりどころ: 1案件だけでは偏る。最低3案件まわす。

引っかかりやすい前提。

GPT-Image-2のThinkingモードはChatGPT Plus・Pro・Business限定(出典: OpenAI)。

APIフリーティアは非対応で、Tier 1レート上限は5 IPM。

用途別にどちらを選ぶか(決定ルール)

固有数字に用途を貼っていきます。

| 用途 | 推奨 | 根拠 |

|---|---|---|

| SNS投稿量産(9:16・1:1を一括) | Nano Banana 2 | 生成3〜5秒・1K $0.067。14種アスペクト比対応。evolink.aiが「rapid iteration向け」と評価 |

| A/Bテスト用バナー100枚 | GPT-Image-2 Low品質 | 1枚$0.006で数量勝負が成立。ただしTier 1は5 IPM上限 |

| ポスター・印刷物(文字含む) | GPT-Image-2 High品質 | Arena編集部門+125点・near-perfectテキスト。$0.211/枚はコスト増だが文字の直し工数で元取り |

| インフォグラフィック・スライド | GPT-Image-2 | VentureBeat「full infographics, slides, maps」と評価 |

| 4K納品(壁紙・大判) | Nano Banana 2 | GPT-Image-2は最大3840px、Nano Banana 2は4096px対応。$0.151/画像 |

| キャラクター一貫性の必要な連作 | Nano Banana 2 | 最大5キャラクター・14オブジェクトの参照サポート |

| インテリア・建築ビジュアライゼーション | Nano Banana 2 | Hacker Newsの投稿者が「more organic design features」と評価、カフェ内装で好評 |

| 推論が必要な複雑プロンプト | GPT-Image-2(Thinkingモード) | 生成前に計画とweb検索を挟む。ただしPlus以上限定 |

私なりの整理を足します。

Arena 242点差は「文字と編集精度」に偏った差。

SNS量産や写実性の案件はむしろNano Banana 2が向く、というのが現状の一次情報の読み取りです。

正直、「どっちが勝ち」という問いは浅い。用途で逆転します。

両モデルの弱点はどこにあるのか

ポジティブ評価だけだと判断がブレるので、批判側も並べます。

GPT-Image-2への批判は、Hacker Newsの議論スレッドが詳しい(出典: HN)。

「A startling number of people either have no arms, one arm...or a shrunken arm」(Hacker News投稿者)

「look impressive at a glance but completely fall apart on closer inspection」(Hacker News投稿者)

同スレッドでは別の投稿者が「12個の同心円を要求すると常に10個しか描かれない」とカウント精度の限界を指摘。

Pokémonグリッドテストを試した投稿者は「Several of the Pokemon are flat-out wrong」と記録しています。

weshop.aiはグラフィックデザイン用途で「language is an imprecise medium for achieving precise results」「terrible for graphic design specifically」と厳しい評価(出典: weshop.ai)。

反復編集すると独特のノイズパターンが出る、とも記録しています。

Nano Banana 2側の弱点(出典: nanobanana2.com/aitoolanalysis.com)。

- 全生成の11.8%が主要な問題あり(88.2%が使用可能)

- 1K解像度でテキストがぼやける場合あり

- ピーク時に503エラー発生報告

- 参照画像を過剰に編集するケース

両方とも「どこかで必ず崩れる」。

11.8%の失敗率は意外と高い。

量産時は必ず検品工程を組む前提で設計する必要があります。

商用利用は両方とも可能なのか

Google(Nano Banana 2)の規約はこう明言(出典: Gemini API Terms)。

「Google won't claim ownership over that content.」

OpenAI(GPT-Image-2)の規約はさらに踏み込んでいます(出典: OpenAI Terms)。

「OpenAI assigns all rights, title, and interest in the output to you (where permitted by law)」

両方とも商用利用可。ただし注意点がいくつか。

- Google無料プランは「プロンプト/レスポンスをプロダクト改善に使用」。商用案件は有料プラン必須(EU・UK・スイスは有料のみ利用可)

- Nano Banana 2は全生成画像にSynthID透かし付与(2026年時点で累計2,000万回以上使用)

- 米著作権庁・各国当局は「人間の介入が十分でないAI生成作品には著作権保護を認めない」傾向

「商用OK」と「著作権で守られる」は別の話。

ここ混同しがち。

私なら契約前にクライアントにこの差を明示します。

FAQ

Nano Banana 2とGemini 3.1 Flash Imageは別物ですか?

同じモデルのブランド名違いです。

公式ブランド名がNano Banana 2、モデルIDがgemini-3.1-flash-image-preview。

Google公式blogとDeepMindモデルページで両方の名前が併記されています。

GPT-Image-2のThinkingモードは誰でも使えますか?

ChatGPT Plus・Pro・Businessの契約者限定です。

OpenAI公式発表で明記。

APIフリーティアはそもそも非対応で、Tier 1の画像生成レートは5 IPM(1分あたり5枚)上限。

GPT-Image-2はStructured Outputsに対応していますか?

非対応です。

OpenAI APIドキュメントが明示しています。

Structured OutputsはAPIから返ってくる出力をJSON形式に強制する仕組みのことですが、GPT-Image-2ではこのモードは使えません。

JSONはあくまでプロンプト内のテキスト構造として渡す形になります。

Function callingやストリーミング、ファインチューニングも非対応。

同じJSONプロンプトを両モデルで完全に使い回せますか?

共通8キー(scene / subject / style / lighting / camera / mood / aspect_ratio / composition)はほぼ通ります。

差分はNano Banana 2のtext_content・text_rendering・meta.thinking_level、GPT-Image-2のuse_case・constraints・change / preserve。

両用テンプレに差分ファイルを重ねる運用が現実的です。

文字描画精度99%は信用できますか?

OpenAI公式発表の明示数字ではありません。

Bind AI記事が「leaked LM Arena data and early tester reports」由来と記録しています。

OpenAI公式の表現は「near-perfect text rendering」まで。

引用する時は出典込みで扱うのが安全です。

Nano Banana 2の4Kは本当に$0.151で生成できますか?

aifreeapi、laozhang.ai、kie.aiの3ソース以上で一致している公式料金表です。

2026年3月2日時点の確認。

バッチAPIなら50%引きで$0.076/画像。

Arena 242点差は絵の質全般の差ですか?

ジャンル別Eloを見ると偏りがあります。

単一画像編集でGPT-Image-2が+125点、マルチ画像編集で+90点。

文字描画と構造制御に差が集中しています。

写実性と速度ではNano Banana 2が優位、というのがjxp.comの整理です。

このページに出てきた言葉

- JSONプロンプト

- 指示内容を

{"scene": "...", "subject": "..."}のように構造化したテキスト形式の指示書 - Elo

- 対戦型のランキング指標。高いほうが人の好み投票で勝ちやすい

- Image Arena

- 同じプロンプトで2つの画像モデルの絵を並べて、人に投票してもらう比較サイト

- 推論モード(Thinking)

- 生成前に「何を描くか」をAI自身が計画してから描き始める動作モード

- キー

- JSONの中で

"scene": "海辺"と書いた時の左側「scene」の部分。指示の項目名 - aspect_ratio

- 画像の縦横比(1:1、16:9 など)を指定する項目

- Structured Outputs

- OpenAIの機能名で、APIの返り値をJSON形式に強制する仕組み。GPT-Image-2では使えない

- エンドポイント

- APIを叩くときのURLの種類。機能ごとに別々のURLが用意されている

- IPM

- Images Per Minute、1分あたり生成できる画像枚数の制限値

- SynthID透かし

- Googleが画像に埋め込む、人の目には見えないAI生成マーク

- ラテン文字

- 英語などで使われるアルファベットの仲間。日本語のかな・漢字とは別系統

参考リンク

- Google公式: Nano Banana 2発表

- DeepMind: Gemini Flash Imageモデルページ

- Gemini API 画像生成ドキュメント

- Google Cloud: Nano Banana公式プロンプトガイド

- OpenAI公式: ChatGPT Images 2.0発表

- OpenAI API: GPT-Image-2ドキュメント

- OpenAI Cookbook: 画像生成プロンプトガイド

- fal.ai: GPT-Image-2プロンプトガイド

- arena.ai テキスト→画像リーダーボード

- jxp.com: GPT-Image-2 vs Nano Banana 2

- weshop.ai: GPT-Image-2の限界

- evolink.ai: 2026年版比較

- Gemini API Terms of Service

- OpenAI Terms of Use

Aisola Labでは2026年4月にNano Banana 2のJSONプロンプト単独記事、GPT-Image-2単独記事も公開しています。

用途ごとのモデル選定は、今回の共通8キー+差分キー設計を軸にすると運用が安定します。

※この記事の内容は執筆時点のものです。AIは進化が速い分野のため、最新の仕様は公式サイトでご確認ください。